Der wichtigste AI‑Act Schritt für Mittelstand‑Teams ist nicht „Paragrafen lesen“. Es ist: Wissen, welche KI ihr überhaupt im Einsatz habt (Use Cases, Daten, Tools, Owner, Kontrolllevel). Wenn du bis 2. August 2026 kein AI‑Inventar hast, wirst du Compliance nicht „nachholen“, sondern im Chaos ersaufen.

Primärquelle: Ab wann gilt was?

- EUR‑Lex Zusammenfassung zur Verordnung (EU) 2024/1689: https://eur-lex.europa.eu/EN/legal-content/summary/rules-for-trustworthy-artificial-intelligence-in-the-eu.html

- Gilt ab 2. August 2026, mit Ausnahmen (u. a. 2. Feb 2025 und 2. Aug 2025).

- AI Act Service Desk (Art. 113, „Entry into force and application“): https://ai-act-service-desk.ec.europa.eu/en/ai-act/article-113

Hinweis: Keine Rechtsberatung. Hier geht’s um Umsetzung/Prozessdesign.

Pain Hook: 2026 fragt euch keiner „Nutzt ihr KI?“ – sondern „Wo genau und wie kontrolliert?“

In echten Mittelstand‑Setups sieht’s oft so aus:

- KI steckt in SaaS‑Tools, Browser‑Extensions, „Testaccounts“, Automationen.

- Daten fließen über E‑Mail, CRM, Tickets, Files, manchmal inkl. PII.

- Entscheidungen sind in Wahrheit halbautomatisch („KI schreibt – Mensch klickt trotzdem schnell auf Senden“).

Das Risiko ist nicht das Modell. Das Risiko ist fehlende Übersicht + fehlender Nachweis, dass ihr steuert.

Das 80/20‑System: Ein AI‑Inventar als interne Mini‑App

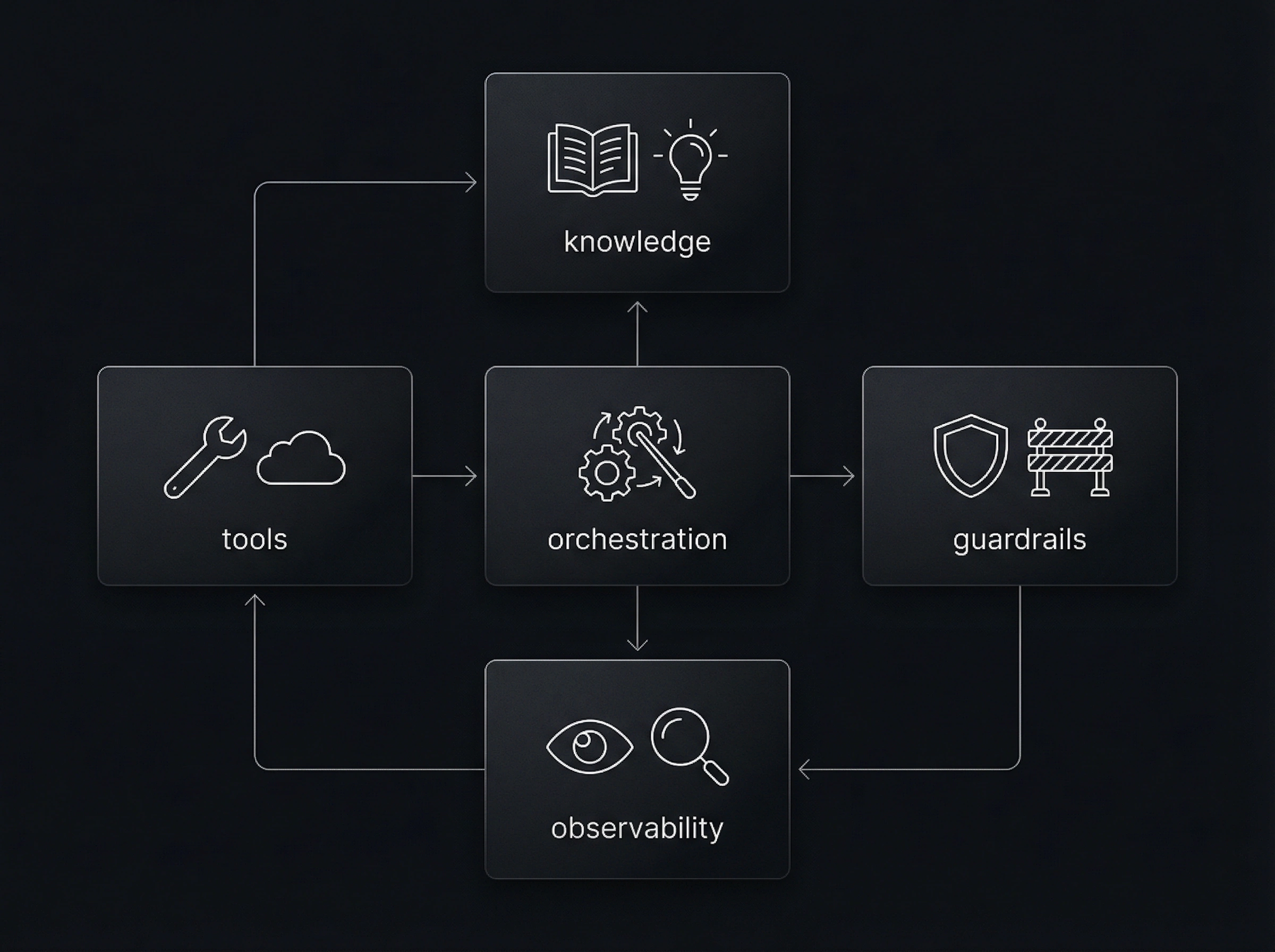

Ein AI‑Inventar ist kein Excel, das nach 2 Wochen stirbt. Es ist eine kleine interne App mit 3 Funktionen:

- Erfassen (welche KI‑Use‑Cases existieren?)

- Einordnen (Kontrolllevel + Risiko‑Flags)

- Nachweisen (Evidence + Audit‑Trail)

Minimum‑Datenmodell (pragmatisch):

- Use Case Name + Ziel (1 Satz)

- Owner (Fachbereich) + Reviewer (IT/Security/DSB)

- Input‑Datenarten (öffentlich/intern/vertraulich/PII)

- Tool/Provider + Hosting/Region (wenn bekannt)

- Output‑Typ (intern/extern) + Fehlerfolgen

- Kontrolllevel (Draft/Assist → Teilautomation → kritisch)

- Logging/Retention (was wird wie lange gespeichert?)

- Evidence‑Links/Uploads (AVV, DPIA/DSFA‑Artefakte, Freigaben)

Was ihr NICHT braucht (und was ihr braucht)

Nicht nötig (für den Start):

- 100% perfekte juristische Klassifizierung

- 60‑seitige Policy‑Dokumente

- „AI Center of Excellence“ als PowerPoint‑Organigramm

Was ihr braucht:

- eine Frontdoor (alle KI‑Use‑Cases landen an einem Ort)

- Ownership (wer haftet operativ? wer reviewt?)

- Gates (wann darf ein Pilot starten, wann nicht?)

- Evidence (wieso habt ihr „ja“ gesagt?)

Checkliste 1: AI‑Inventar Felder (Copy/Paste)

- Use‑Case Name + Ziel (1 Satz)

- Owner (Fachbereich) + Stellvertreter

- Nutzergruppe (wer nutzt es?)

- Tool/Provider/Modell (wenn bekannt)

- Input‑Quellen (E‑Mail/CRM/Files/DB/API)

- Datenarten: öffentlich / intern / vertraulich / PII

- Output: intern vs. extern (Kunde/Partner)

- Human‑in‑the‑loop (wo muss ein Mensch freigeben?)

- Automatisierungsgrad (Assist / Teilprozess / Entscheidung)

- Logging: was wird geloggt? (Inputs/Outputs/Prompts/IDs)

- Aufbewahrung: wie lange? wer hat Zugriff?

- Risiko‑Flags (z. B. People‑Impact, PII, extern)

- Evidence: Links/Files (AVV, DPIA/DSFA, Freigaben)

Checkliste 2: „AI‑Act‑ready“ in 14 Tagen (realistisch)

- Tag 1–2: 15–30 Use‑Cases einsammeln (Workshop + Shadow‑AI fragen)

- Tag 3–4: Mini‑App Datenmodell + Rollen (Owner/Reviewer) festzurren

- Tag 5–7: Review‑Flow bauen (Submitted → Review → Pilot → Approved/Rejected)

- Tag 8–9: Evidence‑Vault + Audit‑Trail (wer hat was wann freigegeben)

- Tag 10–11: Triage‑Wizard (Risiko‑Flags + Standard‑Kontrolllevel)

- Tag 12–14: Pilot‑Playbook (Do/Don’t, Datenregeln, Logging) + Team‑Briefing

CTA: Wir bauen euch die AI‑Inventar‑Mini‑App (ohne Overengineering)

Schick uns:

- eure Top 10 Prozesse, wo KI „irgendwo“ genutzt wird

- welche Tools gerade im Umlauf sind (auch inoffiziell)

- wer bei euch IT/Security/DSB Review macht

Wir liefern in 7–14 Tagen:

- eine interne AI‑Inventar‑Mini‑App (DE/EN UI möglich)

- Review‑Flow + Audit‑Trail

- Templates für typische Mittelstand‑Use‑Cases (E‑Mail‑Assist, Support‑Drafts, Dokumente)