Im Mittelstand scheitert KI selten am Modell – sondern am Chaos: Tools, Daten, Verantwortliche, Freigaben. Bau eine kleine interne AI‑Intake‑Mini‑App, die Use‑Cases einsammelt, grob einordnet, Verantwortliche festlegt und Evidence dokumentiert. Damit bekommt ihr Speed + Kontrolle statt „KI‑Verbot oder Wildwuchs“.

Primärquelle (kurz, aber wichtig)

Die EU hat mit der AI Act Verordnung (EU) 2024/1689 ein risikobasiertes Regelwerk für KI geschaffen. Für Mittelstand‑Teams ist das Entscheidende: Ihr braucht einen Weg, KI‑Use‑Cases zu erfassen und nach Risiko/Scope zu behandeln – bevor ihr skaliert.

Primärquelle:

- EU AI Act (Reg. (EU) 2024/1689) auf EUR‑Lex: https://eur-lex.europa.eu/eli/reg/2024/1689/oj

Hinweis: Keine Rechtsberatung. Das hier ist Prozess‑/Umsetzungshilfe.

Pain/Case Hook: „KI im Team“ wird zur Schatten‑IT

Was 2026 oft passiert:

- Marketing nutzt 3 Tools, Vertrieb 2, HR noch eins.

- Keiner weiß: Welche Daten gehen rein? Wer ist verantwortlich? Wie wird bewertet?

- Legal/IT reagiert mit Stop‑Signs („bitte erstmal klären…“) – und alle sind frustriert.

Bessere Lösung: Nicht „KI erlauben/verbieten“, sondern einen Intake‑Flow bauen.

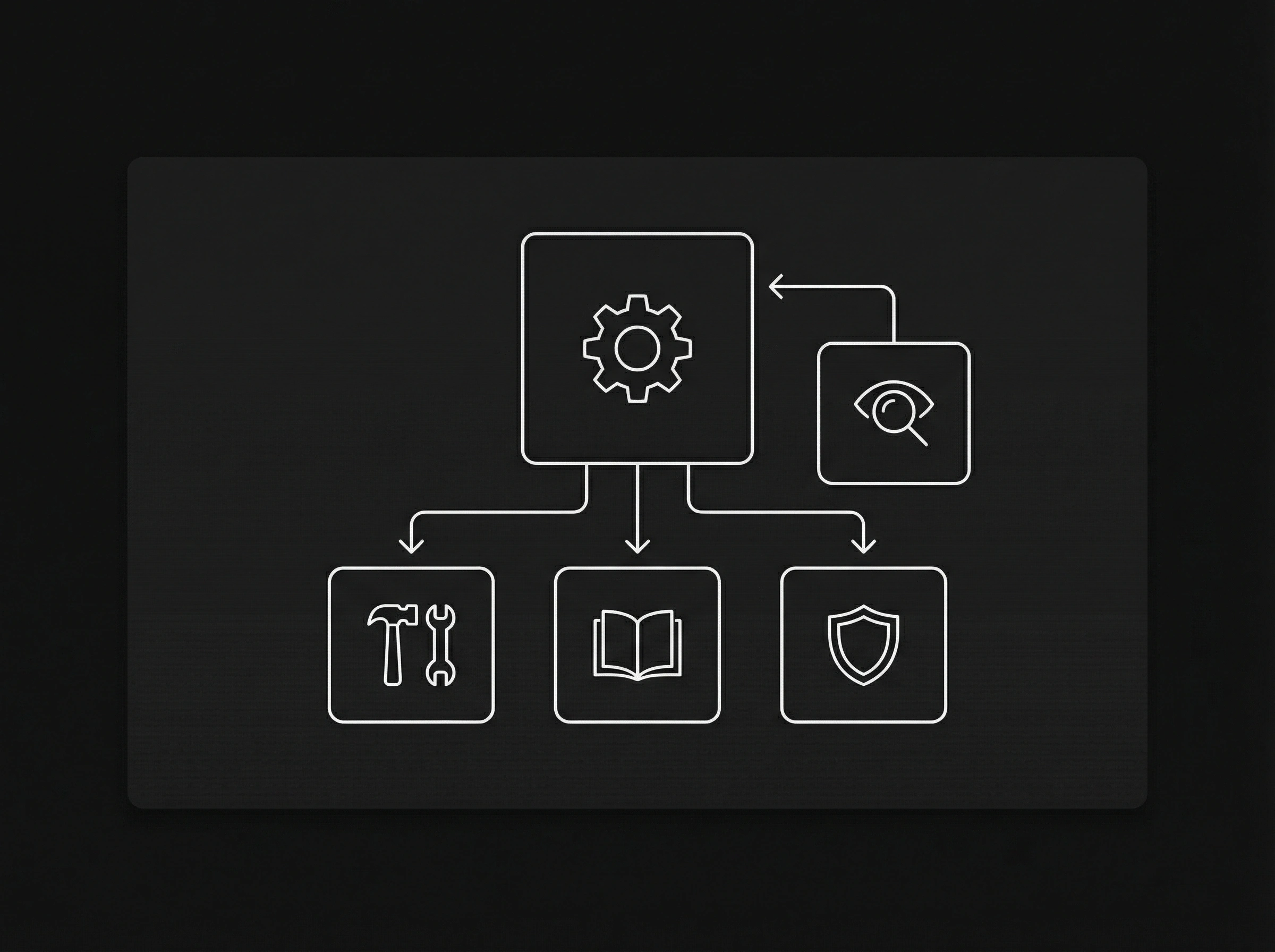

Das Minimal‑System: AI‑Intake‑App als ein einziges Frontdoor

Ziel: Jede KI‑Idee hat einen Ort, eine Owner‑Person, einen Status und ein Evidence‑Set.

Bausteine (80/20):

- Use‑Case Formular (Zweck, Nutzer, Datenarten, Anbieter/Modell, Output)

- Grobe Risiko‑Triage (Low / Medium / High / Unknown)

- Owner + Freigaben (Fachbereich, IT, Datenschutz/Security)

- Pilot‑Gate (Testen darf starten, aber nur mit klaren Regeln)

- Evidence‑Vault (Links, Verträge, DPIA/DSFA‑Artefakte, Freigabe‑Protokoll)

Wie die Triage praktisch aussieht (ohne Juristen‑Overkill)

Ihr braucht keine perfekte Rechts‑Engine – ihr braucht frühe Signale.

Gute Triage‑Fragen:

- Verarbeitet der Use‑Case personenbezogene Daten oder vertrauliche Infos?

- Beeinflusst KI Entscheidungen über Menschen (Hiring, Kredit, Zugang, Bewertung)?

- Ist der Output extern (Kunden) oder intern (Assistenz)?

- Gibt’s automatisierte Entscheidungen ohne menschliche Kontrolle?

- Welche Kontrollen existieren (Logging, Human‑in‑the‑loop, Prompt‑/Policy‑Guardrails)?

Ergebnis: Ihr wisst schnell, ob es ein schneller Pilot oder ein Governance‑Projekt wird.

Checkliste 1: Use‑Case Intake (Copy/Paste)

- Business‑Ziel (1 Satz) + erwarteter Nutzen (Zeit/€, Qualität)

- Nutzergruppe + Verantwortliche Person (Owner)

- Input‑Daten (öffentlich / intern / vertraulich / personenbezogen)

- Output (intern / extern) + Risiko, dass er falsch ist

- Anbieter/Modell (Toolname, Hosting‑Land, Sub‑Processor)

- Integrationen (Slack, CRM, Files, E‑Mail, Tickets)

- Human‑in‑the‑loop: Wo muss ein Mensch bestätigen?

- Logging/Monitoring (was wird gespeichert, wie lange?)

- Go/No‑Go Kriterien für den Pilot

Checkliste 2: AI‑Intake Mini‑App Spezifikation (14‑Tage‑fähig)

- MUSS: Formular + einheitlicher Intake‑Kanal (kein Excel)

- MUSS: Status‑Board (Submitted / In Review / Pilot / Approved / Rejected)

- MUSS: Owner + Reviewer Rollen (Fachbereich/IT/DSB/Security)

- MUSS: Evidence‑Uploads + Audit‑Trail (wer hat wann freigegeben)

- SOLL: Triage‑Wizard (Risiko‑Flags + Standard‑Empfehlungen)

- SOLL: Templates für häufige Use‑Cases (Text‑Assist, Support‑Bot, Zusammenfassung)

- NICE: Auto‑Checks (PII‑Detektion, DLP, Prompt‑Policy)

- NICE: Export als „AI Use‑Case Dossier“ (PDF/ZIP)

14‑Tage Plan (realistisch)

- Tag 1–2: Use‑Case Formular + Review‑Rollen festlegen

- Tag 3–5: Status‑Board + Evidence‑Vault + Audit‑Trail

- Tag 6–8: Triage‑Wizard + Standard‑Pilotregeln (Do/Don’t)

- Tag 9–11: Integrationen (SSO, Slack/Teams, Ticketing)

- Tag 12–14: Export‑Dossier + „AI‑Pilot Playbook“ für Teams

CTA: Wir bauen euch eure AI‑Intake Mini‑App

Schickt uns:

- eure Top 5 KI‑Use‑Cases (kurz)

- welche Daten genutzt werden (intern/PII/vertraulich)

- wer heute blockiert/freigibt (IT/DSB/Security)

Wir bauen daraus eine interne AI‑Intake Mini‑App, die Pilots schnell freigibt, Risiken sichtbar macht und euch eine auditierbare Spur liefert.